Как ИИ меняет мир кибербезопасности – защита или угроза?

В эпоху стремительной цифровизации ландшафт кибербезопасности претерпевает фундаментальные изменения. Традиционные методы защиты информационных систем уже не справляются с растущим объёмом и сложностью угроз, что создаёт благодатную почву для применения искусственного интеллекта (ИИ). Согласно исследованиям, объём глобального рынка ИИ в кибербезопасности увеличивается на 23,6% ежегодно — и это не просто маркетинговая шумиха. Мы наблюдаем реальную трансформацию подходов к защите данных, где машинное обучение и нейросети становятся не просто модными терминами, а насущной необходимостью.

В этом материале мы разберём, как именно искусственный интеллект меняет правила игры в мире кибербезопасности, какие преимущества он даёт защитникам и как его же пытаются использовать злоумышленники. Давайте рассмотрим обе стороны медали этой технологической революции.

- Почему традиционные методы защиты уже не справляются

- Роль и задачи искусственного интеллекта в кибербезопасности

- Анализ больших данных в режиме реального времени

- Обнаружение аномалий и сложных атак

- Предиктивная аналитика и прогнозирование угроз

- Автоматический response на инциденты

- Борьба с фишингом и социнженерией

- Обработка OSINT-данных для выявления угроз

- Преимущества использования ИИ для защиты данных и систем

- Какие проблемы и ограничения есть у ИИ в кибербезопасности

- Ложные срабатывания и шум в данных

- Зависимость от качества обучающих данных

- Уязвимости самих ИИ-систем (атаки на модели)

- Высокая стоимость внедрения и поддержки

- Нехватка специалистов с компетенциями в ИИ и ИБ одновременно

- Как киберпреступники используют ИИ против бизнеса

- Автоматизация взлома паролей и подбора уязвимостей

- Генерация сложных фишинговых атак

- Создание мутирующих вирусов

- Атаки через deepfake и voice spoofing

- Data poisoning — подмена данных для обучения ИИ защитников

- Как балансировать между ИИ-защитой и человеческим фактором

- Примеры использования ИИ в кибербезопасности: кейсы из практики

- Финансовый сектор: Danske Bank

- Телекоммуникации: Vodafone

- Здравоохранение: Kaiser Permanente

- Производство: Toyota

- Перспективы развития ИИ в кибербезопасности

- Рост доли гибридных систем (человек+ИИ)

- Explainable AI в кибербезопасности

- Новые стандарты и регулирование ИИ в ИБ

- Расширение атак с применением ИИ (AI-as-a-Service для хакеров)

- Заключение

- Рекомендуем посмотреть курсы по кибербезопасности

Почему традиционные методы защиты уже не справляются

Традиционные системы кибербезопасности, основанные на сигнатурном анализе и предустановленных правилах, переживают своеобразный кризис эффективности. И дело не только в их технических ограничениях — мы имеем дело с комплексной проблемой, затрагивающей как технологические аспекты, так и человеческий фактор.

За последние пять лет количество кибератак выросло более чем на 300%, при этом их сложность достигла уровня, когда обнаружение вторжений традиционными методами становится практически невозможным. Более того, в отрасли наблюдается критический дефицит квалифицированных специалистов — по оценкам экспертов, в мире не хватает около 3,5 миллионов профессионалов в области информационной безопасности.

Параллельно с этим растёт объём данных, которые необходимо анализировать для выявления потенциальных угроз. Средняя компания генерирует терабайты логов и трафика ежедневно, и человеческий анализ такого массива информации превращается в поиск пресловутой иглы в стоге сена. Возникает закономерный вопрос: как обрабатывать эти данные без применения автоматизированных интеллектуальных систем? Ответ очевиден — никак. И здесь на сцену выходит искусственный интеллект, способный не только справиться с объёмом, но и выявить те закономерности и аномалии, которые человеческий глаз просто не способен заметить.

Роль и задачи искусственного интеллекта в кибербезопасности

В современной парадигме кибербезопасности искусственный интеллект выполняет целый спектр критически важных задач, которые ранее требовали значительных человеческих ресурсов или вовсе оставались нерешенными. Рассмотрим основные направления применения ИИ в этой сфере:

Анализ больших данных в режиме реального времени

Системы на базе ИИ способны обрабатывать колоссальные объемы сетевого трафика, логов и событий безопасности в режиме реального времени. В отличие от традиционных SIEM-систем, искусственный интеллект не просто сопоставляет события с правилами, но анализирует контекст и выявляет неочевидные связи между, казалось бы, несвязанными событиями. Такой подход позволяет значительно снизить количество ложных срабатываний и сократить время на принятие решений.

Обнаружение аномалий и сложных атак

Одна из сильнейших сторон ИИ — способность обнаруживать неизвестные ранее, «нулевого дня» атаки через анализ аномального поведения. Нейросети строят поведенческие профили пользователей, устройств и приложений, что позволяет выявлять отклонения от нормы без необходимости иметь сигнатуру или шаблон атаки. Особенно эффективны в этом отношении алгоритмы unsupervised learning, способные самостоятельно определять аномалии без предварительного обучения на маркированных данных.

Предиктивная аналитика и прогнозирование угроз

Системы ИИ не только реагируют на существующие угрозы, но и предсказывают потенциальные атаки на основе анализа тенденций, исторических данных и моделирования сценариев. Это позволяет перейти от реактивного к проактивному подходу в кибербезопасности, где угрозы нейтрализуются еще до того, как они реализованы.

Автоматический response на инциденты

ИИ-системы способны автоматически реагировать на обнаруженные инциденты — от изоляции зараженных узлов сети до применения патчей и перенастройки правил в межсетевых экранах. Такая автоматизация критически важна в условиях, когда время реакции на угрозу измеряется минутами или даже секундами.

Борьба с фишингом и социнженерией

В области противодействия социальной инженерии ИИ демонстрирует впечатляющие результаты, анализируя содержимое электронных писем, выявляя подозрительные домены и определяя попытки манипуляции в коммуникациях. Современные системы способны определять даже самые продвинутые фишинговые атаки, включая целевой фишинг (spear phishing).

Обработка OSINT-данных для выявления угроз

Искусственный интеллект эффективно мониторит и анализирует огромные массивы данных из открытых источников (OSINT), выявляя потенциальные угрозы для организации — от публикации исходных кодов в открытых репозиториях до обсуждения уязвимостей на хакерских форумах и в даркнете.

Преимущества использования ИИ для защиты данных и систем

Применение искусственного интеллекта в сфере кибербезопасности предоставляет существенные преимущества перед традиционными защитными механизмами. Эти преимущества стоит рассматривать не как теоретические возможности, а как практические инструменты, которые уже сегодня повышают уровень защиты информационных систем. Давайте рассмотрим ключевые преимущества в более структурированном виде:

| Преимущество | Описание |

|---|---|

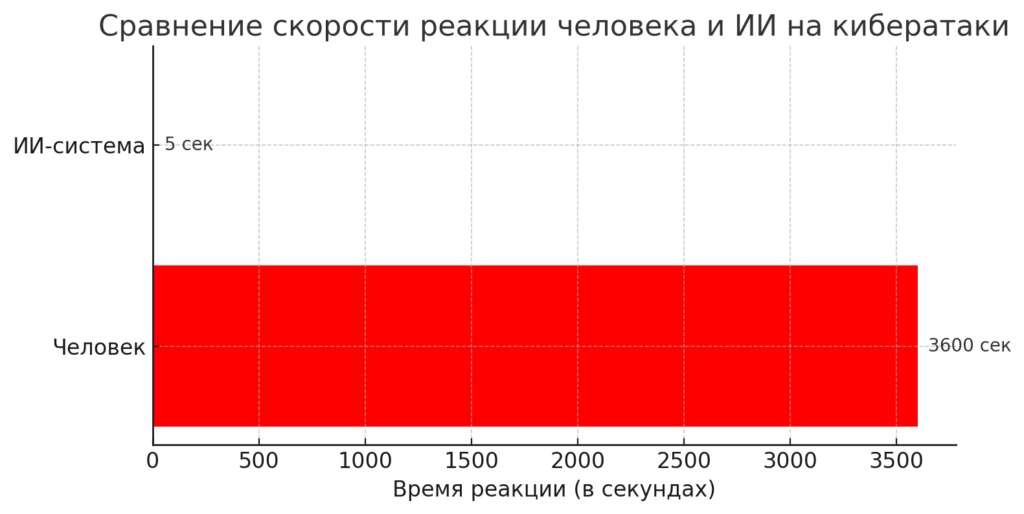

| Скорость | Мгновенная реакция на угрозы в масштабах реального времени. В то время как человеку требуются часы для анализа инцидента, системы на базе ИИ способны обнаруживать и реагировать на атаки в течение секунд, что критически важно при таргетированных атаках. |

| Адаптивность | Самообучающиеся алгоритмы постоянно совершенствуют свою эффективность, адаптируясь к новым типам угроз без необходимости ручной настройки правил. Чем больше данных обрабатывает система, тем точнее становятся её прогнозы и классификации. |

| Масштабируемость | Работа с огромными объемами данных из различных источников одновременно – от сетевого трафика до поведения пользователей и операций с файлами. ИИ способен обрабатывать терабайты информации, что физически невозможно для команды аналитиков. |

| Автоматизация | Снижение нагрузки на специалистов по безопасности за счёт автоматизации рутинных задач, включая классификацию угроз, применение патчей и реагирование на типовые инциденты. Это особенно ценно в условиях глобального дефицита кадров в ИБ. |

| Выявление скрытых угроз | Поведенческий анализ и обнаружение аномалий позволяют выявлять сложные и скрытые атаки, которые не имеют известных сигнатур и потому остаются незамеченными для традиционных систем защиты. |

Диаграмма, показывающая сравнение скорости реакции человека и ИИ на кибератаки

Синергия этих преимуществ создаёт качественно новый уровень защиты, когда система не просто реагирует на известные угрозы, но предугадывает направления атак и адаптируется к изменяющемуся ландшафту киберугроз. Однако стоит помнить, что даже самый совершенный ИИ — это инструмент, эффективность которого зависит от качества его интеграции в общую стратегию кибербезопасности организации.

Какие проблемы и ограничения есть у ИИ в кибербезопасности

При всех впечатляющих возможностях, которые предлагает искусственный интеллект для защиты информационных систем, было бы наивно рассматривать его как панацею от всех кибер-угроз. Как и любая технология, ИИ в кибербезопасности имеет ряд существенных ограничений и проблем, которые необходимо учитывать при построении общей стратегии защиты.

Ложные срабатывания и шум в данных

Одна из наиболее распространённых проблем систем на базе ИИ — так называемые «ложноположительные» срабатывания. Даже самые продвинутые алгоритмы машинного обучения могут ошибочно классифицировать легитимную активность как вредоносную, что приводит к информационному шуму и «усталости от оповещений» у команд безопасности. Согласно исследованиям, до 45% всех оповещений, генерируемых ИИ-системами, требуют дополнительной проверки человеком, что нивелирует преимущество в скорости обработки данных.

Зависимость от качества обучающих данных

Эффективность любой системы машинного обучения напрямую зависит от качества данных, на которых она обучалась. В контексте кибербезопасности это создаёт замкнутый круг: для обучения ИИ нужны данные о новых кибератаках, но эти данные могут появиться только после того, как атаки произойдут. Кроме того, многие организации не имеют доступа к репрезентативным наборам данных о кибер-инцидентах, что ограничивает возможности для эффективного обучения моделей.

Уязвимости самих ИИ-систем (атаки на модели)

Парадоксально, но системы искусственного интеллекта сами могут стать мишенью для атак. Исследователи выявили целый класс атак на модели машинного обучения — от data poisoning (внедрение вредоносных данных в обучающую выборку) до adversarial examples (создание входных данных, специально сконструированных для обмана алгоритмов классификации). Такие атаки особенно опасны, поскольку могут оставаться незамеченными длительное время.

Высокая стоимость внедрения и поддержки

Построение эффективной системы ИИ для кибербезопасности требует значительных инвестиций — как финансовых, так и временных. Помимо стоимости самого программного обеспечения и инфраструктуры, необходимы ресурсы на интеграцию, настройку и постоянное обучение моделей. По данным аналитиков, совокупная стоимость владения (TCO) такими системами может быть на 30-40% выше, чем у традиционных решений безопасности.

Нехватка специалистов с компетенциями в ИИ и ИБ одновременно

На рынке наблюдается острый дефицит профессионалов, обладающих одновременно глубокими знаниями в области кибербезопасности и искусственного интеллекта. Такие специалисты необходимы для эффективной настройки, обучения и интерпретации результатов работы ИИ-систем. Конкуренция за таких экспертов приводит к росту стоимости их услуг, что дополнительно увеличивает порог входа для организаций, желающих внедрить ИИ в свою стратегию защиты.

Понимание этих ограничений — важный шаг к построению реалистичных ожиданий от применения искусственного интеллекта в кибербезопасности. ИИ — мощный инструмент, но не магическое решение всех проблем, и его интеграция должна быть частью комплексного подхода к защите информационных систем.

Как киберпреступники используют ИИ против бизнеса

Пока защитники информационных систем осваивают возможности искусственного интеллекта, киберпреступники не остаются в стороне от технологического прогресса. Мы наблюдаем тревожную тенденцию: злоумышленники всё активнее применяют те же ИИ-технологии для создания более изощрённых и масштабных атак. Своеобразная «гонка вооружений» в киберпространстве выходит на новый уровень сложности.

Автоматизация взлома паролей и подбора уязвимостей

Традиционный перебор паролей (brute force) трансформировался в интеллектуальные системы, использующие машинное обучение для анализа шаблонов в уже утекших базах паролей. Современные ИИ-инструменты для взлома учитывают психологические аспекты создания паролей и способны генерировать высоковероятные комбинации, основываясь на профиле конкретного пользователя.

Аналогичным образом автоматизируется и поиск уязвимостей. В 2023 году исследователи из лаборатории Черного Шляпы продемонстрировали ИИ-систему, способную обнаруживать новые уязвимости в веб-приложениях в 8 раз быстрее, чем опытные пентестеры.

Генерация сложных фишинговых атак

ИИ радикально изменил ландшафт фишинговых атак. Если раньше массовые фишинговые рассылки легко выявлялись по грамматическим ошибкам и шаблонному тексту, то теперь нейросети типа GPT создают безупречные с лингвистической точки зрения сообщения, адаптированные под конкретного получателя.

Пример из практики: В 2024 году была зафиксирована атака на финансовый сектор, где ИИ генерировал персонализированные фишинговые письма, имитирующие стиль общения реальных бизнес-партнеров жертвы на основе анализа их переписки в LinkedIn и других открытых источниках. Уровень успешности таких атак достигал 70%, что в 4 раза выше, чем у традиционного фишинга.

Создание мутирующих вирусов

Искусственный интеллект даёт злоумышленникам возможность создавать полиморфные вредоносные программы, способные изменять свой код при каждом запуске, сохраняя при этом функциональность. Такие «мутирующие» вирусы крайне сложно обнаружить с помощью сигнатурного анализа, поскольку каждый экземпляр имеет уникальную цифровую подпись.

Атаки через deepfake и voice spoofing

Технологии синтеза голоса и deepfake открыли новую эру социальной инженерии. В феврале 2023 года финансовый директор одной из британских компаний перевёл 243 тысячи фунтов стерлингов мошенникам, получив звонок от «CEO» компании с просьбой о срочном переводе. Голос был синтезирован ИИ на основе публичных выступлений настоящего генерального директора.

Data poisoning — подмена данных для обучения ИИ защитников

Особо продвинутые киберпреступные группировки начали атаковать сами механизмы машинного обучения. Внедряя вредоносные образцы в тренировочные данные, они «обучают» системы защиты игнорировать определённые типы атак или идентифицировать вредоносную активность как нормальную.

Пример из практики: Группировка APT29 успешно компрометировала систему безопасности на основе ИИ крупной телекоммуникационной компании, внедрив вредоносные образцы в поток данных, используемых для обучения. Это позволило им оставаться незамеченными в сети более 8 месяцев.

С каждым годом ИИ-инструменты становятся всё доступнее для злоумышленников, формируя новую парадигму «AI-as-a-Service для хакеров». В таких условиях бизнесу необходимо не только внедрять ИИ для защиты, но и учитывать, что противник обладает аналогичными технологическими возможностями.

Как балансировать между ИИ-защитой и человеческим фактором

В погоне за новейшими технологиями легко впасть в крайность, полностью доверившись искусственному интеллекту в вопросах кибербезопасности. Однако практика показывает, что наиболее эффективный подход — это симбиоз человеческого опыта и машинных алгоритмов. Мы называем это «гибридной моделью безопасности», когда ИИ и специалисты дополняют друг друга, компенсируя слабые стороны каждого.

Принципиальный вопрос заключается не в том, заменит ли ИИ человека в кибербезопасности, а в том, как оптимально распределить задачи между человеком и машиной. Исследования показывают, что команды кибербезопасности, использующие ИИ как дополнение к человеческой экспертизе, демонстрируют на 38% лучшие результаты по сравнению с командами, полагающимися только на один из этих компонентов.

Для построения эффективной гибридной системы рекомендуем следовать нескольким ключевым принципам:

- Доверяй, но проверяй — даже самые продвинутые ИИ-системы должны периодически проходить аудит человеком-экспертом. Особенно это касается критических решений, связанных с блокировкой сервисов или изоляцией сетевых сегментов.

- Используйте ИИ для масштабирования, а не замены аналитиков — оптимальное применение искусственного интеллекта заключается в фильтрации и приоритизации инцидентов безопасности, чтобы аналитики могли сосредоточиться на наиболее критичных угрозах.

- Инвестируйте в обучение специалистов работе с ИИ — ценность искусственного интеллекта напрямую зависит от способности команды правильно интерпретировать его выводы и эффективно взаимодействовать с ним.

- Сохраняйте процессы ручного реагирования — всегда имейте резервные процедуры на случай отказа автоматизированных систем. ИИ, как и любая технология, подвержен сбоям и может стать мишенью для атак.

- Поддерживайте разнообразие инструментов — не полагайтесь на единственное ИИ-решение. Различные алгоритмы имеют разные сильные стороны и ограничения, а их комбинация повышает общую устойчивость защиты.

Важно помнить, что в конечном итоге ответственность за кибербезопасность лежит на людях, принимающих решения. Искусственный интеллект — это мощный инструмент, но не волшебная палочка, способная решить все проблемы безопасности без участия человека. Наиболее устойчивые стратегии кибербезопасности по-прежнему требуют глубокого понимания бизнес-контекста, оценки рисков и принятия взвешенных решений — областей, где человеческая интуиция и опыт остаются незаменимыми.

Примеры использования ИИ в кибербезопасности: кейсы из практики

Теоретические рассуждения о потенциале ИИ в кибербезопасности приобретают особую ценность, когда подкрепляются конкретными примерами из реальной практики. Мы собрали несколько показательных кейсов, демонстрирующих эффективность искусственного интеллекта в защите информационных систем.

Финансовый сектор: Danske Bank

Один из крупнейших банков Северной Европы внедрил систему на базе ИИ для выявления мошеннических операций. Решение анализирует более 100 параметров каждой транзакции в режиме реального времени, что позволило снизить количество ложных срабатываний на 60% и сократить финансовые потери от мошенничества на 43 миллиона долларов ежегодно.

Телекоммуникации: Vodafone

Компания Vodafone применила искусственный интеллект для защиты своей инфраструктуры 5G. ИИ-система анализирует сетевой трафик и выявляет аномалии, предупреждая о потенциальных DDoS-атаках за несколько минут до их начала. Это позволяет компании проактивно перенаправлять трафик и минимизировать воздействие атак на клиентов.

Здравоохранение: Kaiser Permanente

Сеть американских клиник внедрила решение на основе ИИ для защиты данных пациентов. Система мониторит поведение пользователей в сети и выявляет аномальные паттерны доступа к медицинским записям. Благодаря этому время обнаружения инсайдерских угроз сократилось с нескольких недель до нескольких часов.

Производство: Toyota

Автомобильный гигант использует ИИ для защиты своей производственной сети от кибератак. Система непрерывно анализирует коммуникации между промышленными контроллерами и выявляет отклонения от стандартных протоколов, что критически важно для предотвращения атак на IoT-устройства в производственной среде.

Эти примеры наглядно демонстрируют, что ИИ в кибербезопасности — это не футуристическая концепция, а уже работающий инструмент, приносящий измеримую пользу бизнесу в различных отраслях. При этом важно отметить, что во всех случаях искусственный интеллект выступает как дополнение к существующим стратегиям безопасности и работе специалистов, а не как их полная замена.

Перспективы развития ИИ в кибербезопасности

Рассматривая траекторию развития искусственного интеллекта в сфере кибербезопасности, мы можем выделить несколько ключевых трендов, которые, вероятно, определят ландшафт отрасли в ближайшие годы. И хотя прогнозирование в столь динамичной области всегда сопряжено с определенной долей погрешности, некоторые тенденции просматриваются достаточно отчетливо.

Рост доли гибридных систем (человек+ИИ)

Будущее кибербезопасности — за гибридными системами, где искусственный интеллект и человек работают в тесной связке, дополняя друг друга. Мы ожидаем, что к 2026-2027 годам до 75% предприятий перейдут на модель Security Copilot, где ИИ выступает в роли «второго пилота» для аналитиков безопасности, предлагая рекомендации и автоматизируя рутинные задачи, но оставляя критические решения за человеком.

Explainable AI в кибербезопасности

Одной из наиболее перспективных областей развития станет Explainable AI (XAI) — подход, при котором алгоритмы не только обнаруживают угрозы, но и предоставляют понятные человеку объяснения своих выводов. Это критически важно в контексте кибербезопасности, где специалистам необходимо понимать, почему система классифицировала определенную активность как вредоносную. XAI позволит преодолеть проблему «черного ящика» нейросетей и повысит доверие к выводам ИИ-систем.

Новые стандарты и регулирование ИИ в ИБ

В регуляторной сфере мы наблюдаем движение к созданию специализированных стандартов для систем искусственного интеллекта в кибербезопасности. Такие инициативы, как NIST AI 100-2e2023 и готовящийся ISO/IEC CD 27090, заложат основу для сертификации ИИ-решений в области защиты информации. Это, в свою очередь, приведет к формированию более зрелого рынка и повысит планку требований к разработчикам таких систем.

Расширение атак с применением ИИ (AI-as-a-Service для хакеров)

Параллельно с развитием защитных технологий будет эволюционировать и инструментарий киберпреступников. Особую обеспокоенность вызывает формирование теневого рынка AI-as-a-Service для хакеров, где злоумышленники без глубоких технических знаний смогут арендовать продвинутые ИИ-инструменты для проведения атак. Это снизит порог входа в киберпреступность и, вероятно, приведет к росту числа инцидентов.

Отдельно стоит отметить, что в условиях обострения геополитической напряженности искусственный интеллект всё чаще будет использоваться в операциях кибершпионажа и целевых атаках на критическую инфраструктуру. Это потребует разработки новых подходов к обеспечению кибербезопасности на национальном уровне, включая создание специализированных систем раннего предупреждения на базе ИИ.

В конечном итоге, мы стоим на пороге новой эры в кибербезопасности, где искусственный интеллект не просто дополняет существующие инструменты защиты, но трансформирует сам подход к обеспечению безопасности информационных систем. И хотя эта трансформация несет с собой новые вызовы, она также открывает беспрецедентные возможности для построения более устойчивых и адаптивных систем защиты.

Заключение

Подводя итоги нашего анализа роли искусственного интеллекта в кибербезопасности, мы можем с уверенностью констатировать: ИИ радикально меняет правила игры в цифровой защите, становясь одновременно и мощнейшим оружием, и щитом. Однако ключевой вывод заключается не в технологической революции как таковой, а в смене парадигмы взаимодействия человека и машины в вопросах безопасности.

Искусственный интеллект не является панацеей от всех киберугроз, и его слепое внедрение без понимания ограничений и потенциальных уязвимостей может создать ложное чувство защищенности. Наибольшую эффективность демонстрирует именно симбиотический подход, когда аналитические способности ИИ усиливают экспертизу и интуицию специалистов по безопасности.

В ближайшие годы мы, вероятно, будем наблюдать трансформацию самой роли специалистов по кибербезопасности — от реактивного реагирования на инциденты к стратегическому управлению ИИ-системами и интерпретации их выводов. Это потребует новых компетенций и междисциплинарного подхода к обучению следующего поколения кибер-защитников.

Для тех, кто заинтересовался возможностями применения искусственного интеллекта в кибербезопасности и хочет углубить свои знания в этой перспективной области, мы рекомендуем обратить внимание на специализированные образовательные программы. На странице курсов по кибербезопасности вы найдете подборку актуальных образовательных программ, которые помогут освоить как фундаментальные основы информационной безопасности, так и передовые методики применения ИИ для защиты информационных систем. Инвестиции в профессиональное развитие в этой области особенно ценны на фоне глобального дефицита квалифицированных специалистов, способных эффективно работать на стыке кибербезопасности и искусственного интеллекта.

Рекомендуем посмотреть курсы по кибербезопасности

| Курс | Школа | Цена | Рассрочка | Длительность | Дата начала | Ссылка на курс |

|---|---|---|---|---|---|---|

|

Специалист по кибербезопасности

|

Eduson Academy

114 отзывов

|

Цена

145 900 ₽

|

От

12 158 ₽/мес

0% на 24 месяца

19 047 ₽/мес

|

Длительность

6 месяцев

|

Старт

26 марта

Вт, Чт, 19:00-22:00 по МСК

|

Подробнее |

|

Кибербезопасность

|

Нетология

46 отзывов

|

Цена

245 000 ₽

|

От

300 ₽/мес

|

Длительность

22 месяца

|

Старт

1 апреля

|

Подробнее |

|

Профессия Специалист по кибербезопасности

|

Skillbox

234 отзыва

|

Цена

178 274 ₽

356 547 ₽

Ещё -20% по промокоду

|

От

5 751 ₽/мес

Без переплат на 31 месяц с отсрочкой платежа 6 месяцев.

|

Длительность

12 месяцев

|

Старт

27 марта

|

Подробнее |

|

Кибербезопасность

|

ЕШКО

19 отзывов

|

Цена

4 352 ₽

5 800 ₽

|

От

1 088 ₽/мес

1 450 ₽/мес

|

Длительность

4 месяца

|

Старт

26 марта

|

Подробнее |

Искусственный интеллект в кибербезопасности — это не просто технология, а новая философия защиты, в которой алгоритмы и человеческий разум взаимно усиливают друг друга. И в этой философии кроется наш главный шанс на поддержание цифрового суверенитета в эпоху, когда киберпространство становится полем боя нового поколения.

Слёрм vs Яндекс Практикум: где полезнее, если цель — инженерная практика, а не «мягкий старт»

Слёрм или Яндекс Практикум DevOps — что выбрать, если уже есть опыт и нужна реальная практика? Разбираем форматы обучения, стек технологий и сценарии, где каждый вариант даёт максимум пользы.

LoftSchool vs Яндекс Практикум: где быстрее собрать портфолио и не застрять на теории

LoftSchool или Яндекс Практикум — что выбрать, если хочется быстрее получить проекты и не утонуть в теории? Разбираем формат обучения, портфолио и реальные сценарии выбора.

Hexlet vs OTUS: где быстрее вырастить “инженерную базу”, а не только “сделать проект”

Выбираете, где обучаться программированию? Сравнение Hexlet и OTUS покажет, какая школа лучше подходит для вашего стиля обучения. Узнайте, какой формат ускорит ваш прогресс!

GeekBrains vs XYZ School в 3D/гейм-арт: что сравниваем и кому какая школа подходит?

Выбираете курс по 3D-геймарту? В статье мы подробно рассмотрим два популярных учебных заведения — GeekBrains и XYZ School. Сравним их подходы, особенности обучения и как выбрать программу, которая подойдет именно вам. Хотите узнать, что важно при выборе курса? Читайте наш материал, и вы найдете ответы на все вопросы!