OTUS vs GeekBrains для backend: где строже к качеству кода и полезнее ревью

Когда речь заходит о выборе онлайн-школы для backend-разработки, вопрос «где лучше?» почти всегда оказывается неправильным. Правильный вопрос звучит иначе: где строже к качеству кода и насколько полезно ревью? Это не одно и то же, что «где интереснее программа» или «где дешевле».

Под «строгостью к качеству кода» мы будем понимать конкретную, измеримую совокупность: наличие критериев приёмки работ, обязательных инженерных практик (PR, тесты, CI, статический анализ) и реальная глубина комментариев — не «молодец, исправь переменную», а разбор архитектурных решений, граничных случаев и читаемости кода.

Сразу предупредим честно: «строгость» — величина непостоянная. Она может различаться в зависимости от конкретного курса, потока, наставника и даже вашей группы. Поэтому помимо сравнения школ мы дадим практическую методику проверки — до оплаты.

Если говорить о позиционировании: GeekBrains традиционно ориентируется на аудиторию «с нуля» и делает акцент на доступности входа — это официально отражено в описаниях большинства программ по backend.

Один из курсов GeekBrains — Python-разработчик. Уже в начале страницы мы видим, что курс рассчитан на студентов без знаний в программировании.

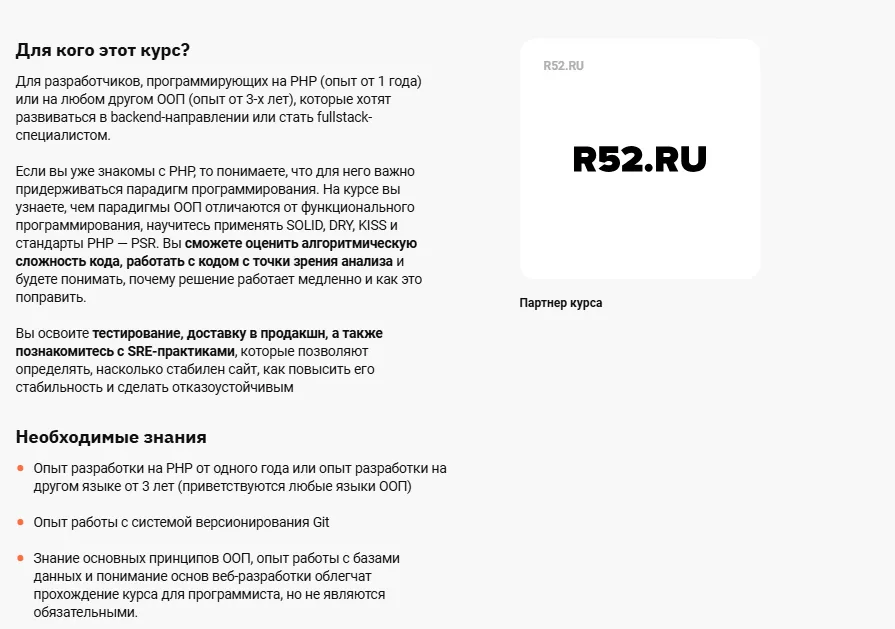

OTUS, напротив, позиционирует многие свои курсы как обучение для людей с базой: там чаще встречаются требования к минимальному опыту или знаниям. Это ключевое структурное различие, которое напрямую влияет на то, каким будет ревью — и насколько оно вас продвинет.

OTUS – о том, для кого курс. Как указано выше, школа позиционирует обучение для тех, у кого уже есть опыт в разработке.

- Как устроено ревью и приёмка работ в OTUS и GeekBrains?

- Где строже к качеству кода: OTUS или GeekBrains — и за счёт чего?

- Кому выбрать OTUS, а кому GeekBrains, если цель — вырасти через ревью?

- Как проверить силу ревью до оплаты: 12 вопросов и 6 артефактов

- Как усилить ревью самому: чек-лист качества + инструменты

- Итоговый вывод: 3 сценария выбора + «если сомневаетесь»

- Рекомендуем посмотреть курсы по backend разработке

Как устроено ревью и приёмка работ в OTUS и GeekBrains?

Прежде чем сравнивать школы, давайте разберёмся с механикой: кто именно смотрит ваш код, в каком формате, как быстро и сколько раз вас могут «завернуть» на доработку. Именно эти параметры определяют, получите ли вы реальный инженерный опыт — или просто галочку о сдаче домашнего задания.

Кто ревьюит — и почему это принципиально важно

На рынке онлайн-образования сложилось несколько базовых моделей проверки работ, и они радикально отличаются по качеству обратной связи.

- Преподаватель или наставник с практическим опытом — наиболее ценный вариант. Такой человек не просто укажет на синтаксическую ошибку, но объяснит, почему выбранный подход не масштабируется или как бы это выглядело на реальном проекте.

- Ассистент курса — промежуточный вариант. Часто это выпускник того же курса или джун с небольшим опытом. Проверку пройти можно, но глубина разбора будет ограничена.

- Peer-review (взаимопроверка студентами) — самый распространённый «бюджетный» формат в массовых онлайн-программах. Проблема очевидна: студент ревьюит студента, оба примерно на одном уровне. Это не экспертное ревью — это совместное блуждание в потёмках, иногда полезное, но системным инструментом роста не являющееся.

- Автотесты — хороший инструмент для проверки корректности решения, но они ловят далеко не всё. Тесты скажут, что функция возвращает правильный результат, но не скажут, что код нечитаем, не обрабатывает исключения и упадёт при первом нестандартном входе в продакшене.

В программах OTUS по backend-направлениям в описаниях курсов и отзывах студентов встречаются сценарии сдачи домашних заданий через PR с проверкой преподавателями, а также использование автотестов как дополнительного инструмента контроля. GeekBrains также применяет автоматизированную проверку на ряде курсов — как элемент удобной сдачи в LMS — однако «человеческая» часть ревью по-прежнему остаётся ключевой переменной качества в обоих случаях.

PR-формат как маркер инженерного обучения

Если домашнее задание сдаётся через Pull Request в репозитории — это хороший знак. Не просто формальность, а реальный инженерный сигнал.

Почему это важно? Работа через PR учит думать иначе: маленькими атомарными изменениями, внятными commit-сообщениями, умением аргументировать своё решение в описании PR. Именно так устроена разработка в большинстве профессиональных команд. Студент, который прошёл через десятки итераций «PR → комментарий → правка → merge», приходит на работу с пониманием процесса, а не просто с набором знаний о синтаксисе.

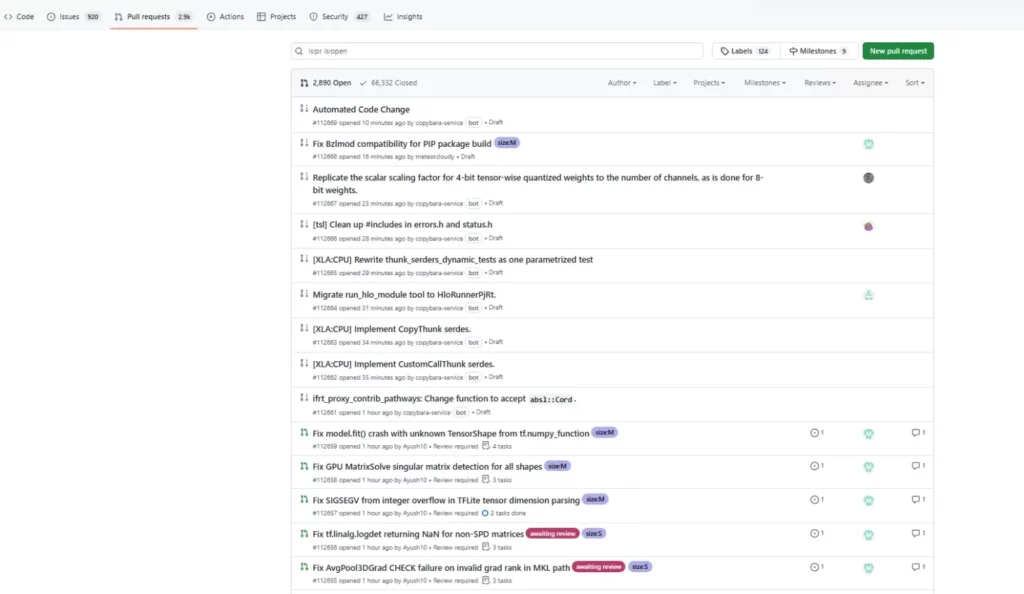

Ревью в формате PR также структурирует обратную связь: комментарии привязаны к конкретным строкам кода, история правок сохраняется, видно, как менялось решение. Это принципиально отличается от ситуации, когда студент загружает архив с кодом в LMS и получает текстовый ответ «в целом хорошо, но посмотри на метод X».Скриншот интерфейса Pull Request на GitHub. Скриншот показывает реальный формат code review: комментарии привязаны к строкам кода, видна история правок и статус проверок.

Скриншот интерфейса Pull Request на GitHub. Скриншот показывает реальный формат code review: комментарии привязаны к строкам кода, видна история правок и статус проверок.

SLA и итерации: три метрики, которыми стоит мыслить

Когда вы выбираете курс, имеет смысл оценивать процесс ревью через три конкретных параметра:

- Скорость ответа. Промышленный стандарт для рабочего ревью — 24–48 часов. В образовательном контексте реалистичный ориентир — 24–72 часа в рабочие дни. Если школа не может назвать конкретный SLA — это уже информация.

- Число итераций. Хорошее ревью почти никогда не заканчивается с первого раза. Если ДЗ принимается сразу у всех — скорее всего, критерии приёмки мягкие или проверка поверхностная. Норма — 1–3 итерации с содержательными правками.

- Качество комментариев. Это самый важный и самый сложно измеримый параметр до начала обучения. Хорошие комментарии: конкретные («здесь лучше использовать паттерн Strategy, потому что…»), системные (указывают на класс проблем, а не единичную ошибку), обучающие (объясняют принцип, а не просто говорят «перепиши»).

Вадим Макишвили, известный евангелист фронтенд-разработки и менторства: «Ревьюер — это не цензор, а зеркало. В хороших школах задача ревью не «принять задачу», а заставить студента отрефлексировать свой выбор».

Три признака формального ревью — мини-чек:

- Комментарии сводятся к «исправь» без объяснения причин.

- ДЗ принимается с первой попытки у подавляющего большинства студентов.

- Обратная связь не привязана к конкретным строкам кода и не содержит альтернативных подходов.

Итоговый микровывод этого раздела звучит так: «строгость» ревью начинается не с жёсткости проверяющего, а с понятных критериев приёмки и повторяемого процесса. Школа может декларировать строгость — но если процесс непрозрачен, критерии размыты, а проверяющий меняется от потока к потоку, предсказуемого качества не будет.

Где строже к качеству кода: OTUS или GeekBrains — и за счёт чего?

Прежде чем сравнивать две школы, нужно договориться о системе координат. «Строгость к качеству кода» — понятие многоуровневое, и то, что кажется строгим на одном этапе обучения, может оказаться минимальной планкой на другом. Давайте выстроим модель — а затем приложим её к обеим платформам.

Четыре уровня строгости: от форматирования до архитектуры

Удобно мыслить строгость ревью как четыре последовательных уровня, каждый из которых включает предыдущий:

- Уровень 1 — Стиль и форматирование. Соблюдение code style, правила именования, отсутствие «мусорного» кода (закомментированные блоки, неиспользуемые импорты). Это базовый гигиенический минимум, который должен закрываться автоматически — линтерами и форматтерами.

- Уровень 2 — Корректность и граничные случаи. Правильно ли работает решение не только на «счастливом пути», но и при пустых входных данных, нулевых значениях, неожиданных типах? Обрабатываются ли ошибки или они просто «проглатываются»?

- Уровень 3 — Тесты, контракты, API. Есть ли покрытие тестами? Насколько понятен публичный интерфейс модуля? Корректно ли спроектированы API-контракты? Логируются ли события правильно?

- Уровень 4 — Архитектура, производительность, безопасность, наблюдаемость. Масштабируется ли решение? Нет ли очевидных узких мест по производительности? Учтены ли базовые требования безопасности? Насколько система «наблюдаема» — можно ли понять, что происходит внутри, не перечитывая весь код?

Алексей Рыбак, экс-СТО Badoo/Bumble, автор канала «Ryback Tech»: «Обучение без жесткого код-ревью — это карго-культ. Студент думает, что он пишет код, но он просто складывает пазлы. Настоящее обучение начинается в момент столкновения с критикой архитектуры, когда тебе говорят не «как исправить», а «почему это не будет работать под нагрузкой»».

Большинство образовательных программ уверенно работают на уровнях 1–2. Уровень 3 встречается реже и обычно является маркером «инженерной» программы. Уровень 4 — редкость даже в хороших курсах, но его элементы в хорошем ревью должны появляться хотя бы в финальных проектах.

Quality gates: что делает качество неизбежным

Строгость ревью — это не только про глубину комментариев. Это ещё и про инфраструктуру, которая делает плохой код физически неудобным для сдачи. Такую инфраструктуру называют quality gates — буквально «ворота качества».

В зрелом варианте это выглядит так:

- Линтеры и форматтеры (например, flake8/black для Python, golangci-lint для Go) — код с нарушениями стиля не проходит проверку автоматически.

- Обязательные тесты — минимальный порог покрытия как условие приёмки.

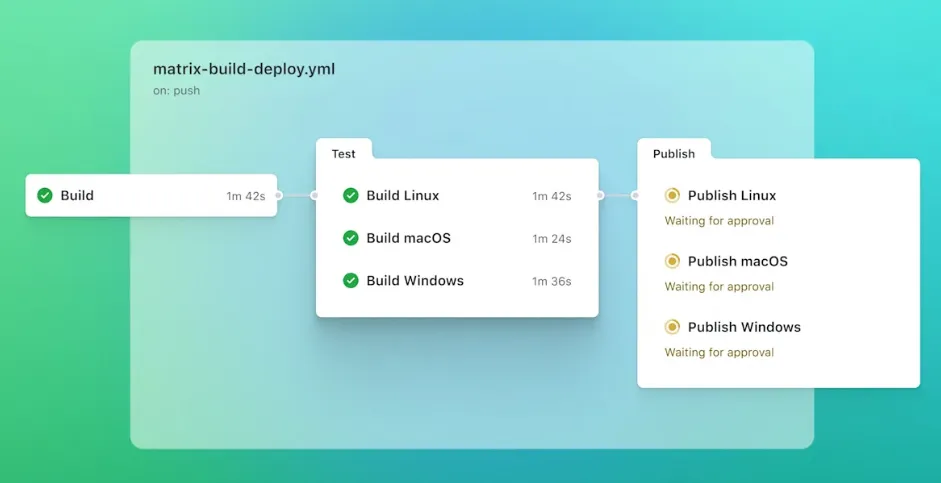

- CI-пайплайн (GitHub Actions, GitLab CI и аналоги) — каждый PR автоматически прогоняется через набор проверок, и ревьюер видит статус до того, как откроет код.

- Статический анализ — инструменты типа mypy, SonarQube или встроенные в IDE проверки, которые ловят потенциальные баги ещё до запуска.

Когда quality gates выстроены корректно, студент не может случайно сдать работу с очевидными проблемами — система не пропустит. Это снимает часть нагрузки с ревьюера и позволяет ему сосредоточиться на том, что автоматика не поймает: архитектуре, читаемости, реальной применимости решения.

Скриншот GitHub Actions. Показывает, как автоматические проверки блокируют некачественный код.

В описаниях ряда программ OTUS по backend и смежным направлениям явно фигурируют практики командной разработки, code review и работа с CI-инструментами — как часть учебного процесса, а не опциональный бонус. Это сигнал того, что quality gates как концепция присутствует в программе осознанно.

OTUS vs GeekBrains: сравнение по проверяемым признакам

Избегать субъективных оценок «лучше/хуже» в этом сравнении — принципиальная позиция. Вместо этого предлагаем рабочую формулу:

Если программа включает PR-процесс + обязательные тесты + дедлайны с реальными последствиями + разбор архитектурных решений — она, как правило, строже.

Приложим эту формулу к обеим платформам.

Таблица: OTUS vs GeekBrains — признаки сильного ревью

| Признак | OTUS | GeekBrains |

|---|---|---|

| Сдача ДЗ через PR | Встречается в ряде backend-программ | Преимущественно через LMS |

| Кто ревьюит | Преподаватель / наставник | Преподаватель / ассистент / автотесты |

| Обязательные тесты | Упоминаются в части программ | Зависит от курса и этапа |

| CI как обязательный гейт | Присутствует в командных проектах | Опционально / не везде |

| Статический анализ | Рекомендуется, местами обязателен | Упоминается как инструмент |

| Число итераций ревью | Несколько, с содержательными правками | Варьируется по курсу |

| Прозрачность критериев приёмки | Чек-листы в части программ | Описание в задании |

| Практика продакшен-кейсов | Присутствует, особенно в финальных проектах | Присутствует на продвинутых курсах |

Важная оговорка: таблица отражает типичные паттерны на основе публичных описаний программ и отзывов — конкретный поток может отличаться. Всегда уточняйте перед оплатой.

Для GeekBrains важно понимать контекст: официальное позиционирование большинства backend-программ — старт «с нуля». Это означает, что на ранних этапах критерии приёмки объективно мягче — иначе новичок просто не пройдёт дальше первого модуля. Глубина ревью при этом может расти по мере продвижения по программе, особенно если предусмотрены наставники и финальные проекты. Автотесты как инструмент проверки у GeekBrains присутствуют — это сигнал наличия хотя бы базовой автоматизации — но качество именно человеческого ревью по-прежнему остаётся главной переменной.

Таблица: Матрица строгости качества кода — 12 критериев

| Критерий | Как проверить | Что считается «строго» | Почему важно |

|---|---|---|---|

| Наличие чек-листа приёмки | Запросить у менеджера до оплаты | Конкретные пункты, а не «код должен работать» | Без критериев ревью субъективно |

| PR-процесс | Уточнить формат сдачи ДЗ | ДЗ сдаётся через PR в репозитории | Учит реальному рабочему процессу |

| Кто ревьюит | Спросить напрямую | Практикующий разработчик / наставник | Экспертиза ревьюера определяет глубину |

| Обязательные тесты | Посмотреть описание заданий | Тесты — условие приёмки, не рекомендация | Без тестов код не проверен по-настоящему |

| CI-пайплайн | Попросить пример репозитория | Автоматические проверки при каждом PR | Делает quality gates системными |

| Статический анализ | Уточнить стек инструментов | Линтеры обязательны, а не опциональны | Ловит проблемы до ревью человеком |

| Скорость ответа (SLA) | Спросить конкретные сроки | До 72 часов в рабочие дни | Влияет на темп обучения |

| Число итераций | Спросить у выпускников / в отзывах | Несколько итераций — норма | Одна итерация = поверхностная проверка |

| Глубина комментариев | Попросить анонимизированный пример | Конкретика + альтернативы + принцип | Комментарии «перепиши» ничему не учат |

| Разбор архитектуры | Посмотреть программу / попросить демо | Присутствует хотя бы в финальном проекте | Архитектура — главный навык senior-уровня |

| Требования к безопасности | Уточнить в описании программы | Хотя бы базовые практики упомянуты | Безопасность нельзя «добавить потом» |

| Практика продакшен-кейсов | Посмотреть проекты выпускников | Реальные кейсы, а не учебные игрушки | Работодатели смотрят на портфолио |

Цена строгости: нагрузка и темп

Здесь важно сказать прямо: строгий контроль качества кода почти всегда означает больше времени на доработки. Это не недостаток — это особенность формата. Если программа возвращает работу на правки 2–3 раза с содержательными комментариями, студент тратит на одно ДЗ в разы больше времени, чем тот, чью работу приняли с первого раза.

Практика показывает, что студенты программ OTUS нередко отмечают высокую нагрузку как характерную черту обучения — и это косвенно свидетельствует о том, что «строгость» там не декларативная. Рассчитывать на 6–10 часов в неделю при выборе интенсивного backend-курса с реальным ревью — минимальный ориентир. В периоды финальных проектов цифра может вырасти вдвое.

Это не повод отказываться от строгой программы. Это повод реалистично оценить свои возможности до оплаты.

Кому выбрать OTUS, а кому GeekBrains, если цель — вырасти через ревью?

Сравнительные таблицы — хорошо, но в какой-то момент нужно просто принять решение. Давайте разберём три реальных сценария — и честно скажем, какой формат обучения с большей вероятностью даст нужный результат в каждом из них.

Сценарий 1: «Я новичок, мне важна поддержка и понятный вход»

Если вы только начинаете путь в backend-разработке — пишете первые функции, разбираетесь с HTTP и базами данных — то жёсткое инженерное ревью на этом этапе может принести больше вреда, чем пользы. Не потому что строгость плоха, а потому что она должна соответствовать уровню: комментарий «здесь нарушен принцип единственной ответственности» бесполезен, если человек ещё не понимает, что такое класс.

GeekBrains в этом сценарии выглядит логичнее: позиционирование «с нуля» — не маркетинговый слоган, а реальная настройка программы под аудиторию без опыта. Темп, подача материала, критерии приёмки — всё это адаптировано под постепенное погружение.

Риск, о котором стоит знать заранее: качество ревью в массовых программах может быть неравномерным от потока к потоку и от наставника к наставнику. Это не уникальная проблема GeekBrains — это системная особенность любого крупного онлайн-образования. Страховка здесь одна: до оплаты задать конкретные вопросы о процессе проверки и попросить артефакты (подробнее — в следующем разделе).

Сценарий 2: «У меня есть база, хочу строгую инженерную планку и ревью как на работе»

Если вы уже пишете код, понимаете основы и хотите получить опыт, максимально приближённый к промышленной разработке — критерии выбора меняются. Здесь важны не объяснения «что такое REST», а реальная практика: PR, итерационное ревью, обязательные тесты, разбор архитектурных решений.

Маркеры программы, которая это даёт:

- ДЗ сдаётся через PR, а не загрузкой файла в LMS.

- Есть явные требования к тестам как условию приёмки.

- CI-пайплайн — часть процесса, а не опция.

- Ревьюер — практикующий разработчик, а не ассистент-студент.

- Финальный проект разбирается в том числе с точки зрения архитектуры.

По этим признакам ряд backend-программ OTUS выглядит предпочтительнее для данного сценария: в описаниях курсов и отзывах студентов встречаются именно такие форматы работы. Это не гарантия — но это сигнал, который стоит проверить конкретными вопросами перед оплатой.

Сценарий 3: «Я работаю и хочу баланс — строго, но не убиться»

Пожалуй, самый распространённый сценарий среди людей, которые уже работают и хотят вырасти параллельно с основной занятостью. Здесь строгость ревью важна, но не менее важна предсказуемость нагрузки.

Как оценивать нагрузку до начала обучения:

- Уточните реальное количество часов в неделю — не по рекламному буклету, а у выпускников или действующих студентов.

- Спросите, есть ли дедлайны и что происходит при их нарушении (хвосты, отчисление, перенос).

- Узнайте, сколько итераций ревью типично для одного ДЗ — это напрямую влияет на временные затраты.

Практика показывает, что 6–12 часов в неделю — это реалистичный минимум для программы с реальным ревью и итерациями. Это не универсальное правило для всех курсов, но хорошая «калибровка ожиданий»: если школа обещает результат при 3 часах в неделю и при этом говорит о строгом ревью — одно из двух неправда.

В этом сценарии выбор между OTUS и GeekBrains менее однозначен: важнее найти конкретную программу с понятным SLA по ревью и прозрачными дедлайнами, чем ориентироваться на бренд. Обе школы имеют форматы с наставниками — вопрос в том, насколько это подкреплено реальным процессом в конкретном потоке.

Таблица: выбор за 60 секунд — 3 сценария

| Ситуация | Вероятно подойдёт | На что обратить внимание |

|---|---|---|

| Новичок, опыта нет, важна поддержка | GeekBrains (backend с нуля) | Уточнить, кто ревьюит и есть ли наставник |

| Есть база, нужна инженерная строгость | OTUS (backend-программы с PR/code review) | Проверить наличие CI, тестов, PR-процесса |

| Работаю, нужен баланс строгости и нагрузки | Любая школа — но конкретная программа, не бренд | Уточнить SLA, часы/неделя, политику дедлайнов |

Как проверить силу ревью до оплаты: 12 вопросов и 6 артефактов

Любое сравнение школ — включая то, что мы делали в предыдущих разделах — это работа с усреднёнными сигналами. Реальное качество ревью в конкретном потоке, с конкретным наставником, на конкретном курсе вы узнаете только одним способом: задав правильные вопросы до оплаты. Давайте разберём протокол такой проверки — системно и без лишней воды.

Схема оценки ревью до оплаты

Процесс проверки удобно представить как три последовательных шага:

Вопросы (выясняем процесс) → Артефакты (смотрим доказательства) → Демо (проверяем вживую) → Финальная оценка рисков

Если школа проходит все три этапа без уклончивых ответов — это хороший знак. Если на каком-то шаге начинаются «ну, это зависит от потока» и «уточним позже» — вы уже получили важную информацию.

12 вопросов перед оплатой курса

Таблица: 12 вопросов — зачем задавать и какой ответ говорит о качестве

| № | Вопрос | Зачем спрашивать | Ответ ОК | Ответ — повод насторожиться |

|---|---|---|---|---|

| 1 | ДЗ сдаётся через PR в репозитории или загрузкой в LMS? | PR = инженерный процесс, LMS = удобство без практики | Через PR с историей изменений | «Загружаете файл / ссылку в систему» |

| 2 | Есть ли чек-лист приёмки с конкретными критериями? | Без критериев ревью субъективно | Да, по каждому ДЗ есть пункты проверки | «Преподаватель смотрит по ситуации» |

| 3 | Кто именно ревьюит: преподаватель, ассистент, наставник или peer-review? | Экспертиза ревьюера определяет глубину | Практикующий разработчик / наставник с опытом | «Студенты проверяют друг друга» |

| 4 | Есть ли минимальные требования к тестам как условие приёмки? | Тесты — не рекомендация, а гейт качества | Да, без тестов работа не принимается | «Тесты приветствуются, но не обязательны» |

| 5 | Есть ли CI / автотесты / линтеры как обязательный элемент процесса? | Quality gates делают строгость системной | CI запускается автоматически при каждом PR | «Можете настроить сами, если хотите» |

| 6 | Сколько итераций «вернули на доработку» типично для одного ДЗ? | Одна итерация = вероятно, поверхностная проверка | 1–3 итерации с содержательными правками | «Обычно принимаем с первого раза» |

| 7 | Какой SLA по проверке — сколько ждать ответа? | Влияет на темп обучения и планирование | До 48–72 часов в рабочие дни | «Стараемся быстро, но не гарантируем» |

| 8 | Можно ли увидеть анонимизированный пример реального ревью? | Слова о глубине проще всего проверить примером | Да, показывают конкретный PR с комментариями | Отказ или «у нас нет таких примеров» |

| 9 | Есть ли демо-занятие или запись разбора code review? | Живой разбор показывает реальный уровень | Да, есть открытые демо или записи | «Всё увидите после оплаты» |

| 10 | Разбирается ли архитектура решения — или только корректность? | Архитектура = рост до middle/senior уровня | Да, особенно в финальных проектах | «Главное — чтобы тесты проходили» |

| 11 | Что происходит при нарушении дедлайна? | Дедлайны с последствиями = реальная нагрузка | Чёткая политика: хвосты / перенос / отчисление | «Всё гибко, подстроимся» |

| 12 | Можно ли пообщаться с выпускником или действующим студентом? | Лучший источник правды о реальном процессе | Да, дают контакты или организуют встречу | Уклончивый ответ или отказ |

6 артефактов, которые стоит запросить

Вопросы — это хорошо. Но вопросы без артефактов легко превращаются в убедительные ответы менеджера по продажам. Попросите увидеть конкретные материалы:

- Пример PR-ревью — анонимизированный Pull Request с реальными комментариями ревьюера. Смотрите на конкретность, глубину и тон комментариев.

- Чек-лист приёмки — документ с критериями, по которым оценивается домашнее задание. Хороший чек-лист конкретен: не «код должен быть читаемым», а «функции не длиннее 20 строк, нет магических чисел, все публичные методы задокументированы».

- Описание процесса проверки — как именно устроен путь от сдачи ДЗ до финального «принято». Кто участвует, сколько этапов, что происходит при несогласии с ревью.

- Пример задания с критериями оценки — само ДЗ плюс то, по каким параметрам оно будет оцениваться. Это позволяет понять, насколько глубоко программа заходит в инженерные практики.

- Демо-урок или запись занятия — желательно именно разбор кода или code review, а не вводная лекция. В OTUS, например, встречаются публичные демо-занятия с разборами кода — аналогичный формат стоит запросить у любой школы.

- Фрагмент репозитория выпускного проекта — без приватных данных. Структура проекта, наличие тестов, README, история коммитов — всё это говорит о реальных стандартах, которых придерживается программа.

Чек-лист: красные флаги слабого ревью

Если в процессе проверки вы замечаете хотя бы 3–4 из следующих признаков — это серьёзный повод пересмотреть решение об оплате:

- ДЗ сдаётся загрузкой файла в LMS, без PR и репозитория.

- Кто ревьюит — непонятно или «зависит от потока».

- Нет чек-листа приёмки или он сформулирован размыто.

- Тесты не являются обязательным условием сдачи.

- CI и линтеры — опциональны или вообще не упоминаются.

- «Обычно принимаем с первого раза» — как норма, а не исключение.

- SLA по проверке не зафиксирован и не гарантируется.

- Анонимизированный пример ревью показать отказываются.

- Демо-занятие по разбору кода недоступно до оплаты.

- Контакт с выпускником или студентом — под вопросом.

- На вопрос об архитектурном ревью отвечают уклончиво.

- Нагрузка описывается как «всё очень гибко и комфортно».

Последний пункт — про «гибкость и комфорт» — заслуживает отдельного комментария. Строгое ревью по определению не может быть полностью комфортным: оно требует времени на доработки, интеллектуального усилия и готовности получать критику. Если школа обещает одновременно строгость и максимальный комфорт — стоит уточнить, что именно имеется в виду под каждым из этих слов.

Как усилить ревью самому: чек-лист качества + инструменты

Допустим, вы выбрали курс, прошли проверку по 12 вопросам и 6 артефактам — и ревью оказалось «нормальным, но не жёстким». Или вы уже учитесь и понимаете, что глубина обратной связи вас не вполне устраивает. Это не тупик — это задача, которую можно решить самостоятельно. Давайте разберём, как выстроить личную систему качества поверх того, что даёт школа.

Чек-лист самопроверки перед сдачей работы

Первый и самый очевидный шаг — не ждать замечаний от ревьюера по тому, что вы могли найти сами. Хорошее правило: перед каждой сдачей пройтись по собственному коду как чужому — без скидок на «я знаю, что имел в виду».

- Стиль и форматирование — код отформатирован согласно принятому стандарту (PEP8, Google Style Guide и т.д.), нет смешения стилей.

- Именование — переменные, функции и классы названы понятно и последовательно, нет data2, tmp, func1.

- Мёртвый код — удалены все закомментированные блоки, неиспользуемые импорты и переменные.

- Линтер — код прогнан через линтер, все предупреждения разобраны (не проигнорированы).

- Типизация — там, где язык поддерживает, расставлены аннотации типов; проверка через mypy или аналог пройдена.

- Граничные случаи — функции проверены на пустые входные данные, нулевые значения, неожиданные типы.

- Обработка ошибок — исключения перехватываются осмысленно, а не «проглатываются» пустым except.

- Логирование — важные события и ошибки логируются на правильном уровне (DEBUG/INFO/ERROR), нет print в продакшен-коде.

- Тесты — написаны тесты на основные сценарии и граничные случаи, тесты реально проверяют логику, а не просто запускаются.

- Покрытие — покрытие тестами проверено инструментом (coverage.py, pytest-cov), очевидные пробелы закрыты.

- Контракты и API — публичные интерфейсы задокументированы, поведение при ошибках описано явно.

- Читаемость — функции делают одно дело, нет вложенности глубже 3 уровней без явной необходимости.

- Магические числа и строки — вынесены в константы с понятными именами.

- Безопасность — нет явных уязвимостей: пользовательский ввод валидируется, секреты не захардкожены в коде.

- Зависимости — используемые библиотеки зафиксированы в requirements.txt / go.mod / package.json, нет избыточных зависимостей.

Пятнадцать пунктов — это не много, если превратить их в привычку. Первые несколько раз уйдёт час. Через месяц большинство из них будут закрываться автоматически ещё в процессе написания кода.

«Делаем качество неизбежным»: инструменты и автоматизация

Следующий уровень — перестать полагаться на дисциплину и встроить проверки в сам процесс работы. Это то, что в профессиональной среде называют «shifting quality left» — сдвигом контроля качества как можно раньше в цикл разработки.

Практическая схема для учебного проекта:

Pre-commit хуки — автоматические проверки, которые запускаются перед каждым коммитом и не дают зафиксировать код с явными проблемами. Инструмент pre-commit (для Python и не только) позволяет настроить это за 15 минут: линтер, форматтер, базовая проверка типов — всё запускается автоматически.

Линтеры и форматтеры — минимальный набор зависит от языка:

- Python: flake8 + black + isort.

- Go: golangci-lint (включает десятки проверок «из коробки»).

- JavaScript/TypeScript: eslint + prettier.

Минимальный CI на GitHub Actions — даже для учебного репозитория несложно настроить пайплайн, который при каждом пуше запускает линтер и тесты. Это занимает около получаса, зато приучает думать о коде как о системе, а не наборе файлов.

Статический анализ — mypy для Python, встроенные проверки в Go, SonarLint как плагин для IDE — ловят потенциальные баги ещё до запуска кода.

Важный момент: не нужно настраивать всё сразу. Начните с линтера и pre-commit — этого уже достаточно, чтобы к ревьюеру приходил код без элементарных проблем, и он мог сосредоточиться на архитектуре и логике.

Тренировка ревью: как развивать навык вне курса

Умение давать и получать ревью — отдельный профессиональный навык, который не развивается сам по себе. Если курсовое ревью недостаточно интенсивное, есть три работающих способа его усилить.

- Ревьюить чужие PR в open source. Выберите небольшой активный проект на GitHub в вашем стеке — и начните читать открытые Pull Requests с комментариями мейнтейнеров. Это бесплатная школа реального ревью: видно, на что обращают внимание опытные разработчики, какие аргументы они приводят, как формулируют замечания. Следующий шаг — самостоятельно оставлять комментарии к чужим PR, даже если вы не мейнтейнер.

- Разбирать демо-ревью и записи code review. На YouTube и в технических блогах достаточно материала, где опытные разработчики разбирают реальный код вслух. Это полезнее, чем читать статьи о принципах: вы видите живое мышление ревьюера — как он замечает проблему, формулирует её и предлагает альтернативу.

- Вести журнал типовых замечаний. Простая практика с высоким ROI: после каждого ревью фиксируйте замечания в структурированном виде — категория проблемы, конкретный пример, как исправили, как избежать в будущем. Через 2–3 месяца у вас сложится личная карта типовых ошибок — и вы начнёте замечать их сами до сдачи.

Если в программе OTUS или GeekBrains есть контент про code review как профессиональный навык — это стоит использовать как отправную точку. Но системное развитие этого навыка всегда выходит за рамки одного курса: оно строится на практике, рефлексии и постоянном контакте с чужим кодом.

Итоговый вывод: 3 сценария выбора + «если сомневаетесь»

Мы разобрали механику ревью, выстроили матрицу строгости, прошлись по сценариям выбора и дали протокол проверки до оплаты. Время собрать всё в три коротких вывода — без повторения того, что уже сказано.

Вывод первый: строгость выше там, где она встроена в процесс, а не декларирована в описании.

Если программа предполагает PR, обязательные тесты, CI и итерационное ревью от практикующего разработчика — она структурно строже, вне зависимости от бренда. По совокупности публичных сигналов ряд backend-программ OTUS ближе к этой модели. Но это не универсальное правило: конкретный поток всегда важнее общей репутации школы.

Вывод второй: когда правильнее выбрать «вход и поддержку».

Если вы начинаете с нуля — жёсткое инженерное ревью на старте не ускорит рост, а затормозит его. GeekBrains с позиционированием «для новичков» в этом сценарии логичнее: адаптированный темп и постепенное усложнение важнее строгости критериев на первом этапе. Главное — понимать, что по мере роста планку придётся поднимать самостоятельно: через open source, личные проекты и практики из H2-5.

Вывод третий: не покупайте бренд — покупайте процесс.

Финальное правило, которое работает для любой школы: сохраните чек-лист из 12 вопросов и запросите 6 артефактов до оплаты. Если школа отвечает конкретно и показывает реальные примеры — это хороший знак. Если уходит в общие слова — вы уже получили ответ. Если сомневаетесь: не сравнивайте OTUS и GeekBrains как бренды — сравнивайте конкретные программы по конкретным критериям. Два курса в одной школе могут отличаться по качеству ревью сильнее, чем курсы разных школ. Инструмент для такого сравнения у вас теперь есть.

Если вы только начинаете осваивать бэкенд-разработку и хотите системно изучить инженерные практики, рекомендуем обратить внимание на подборку курсов по backend-разработке. В таких программах обычно есть теоретическая и практическая часть, где можно отработать навыки написания кода и пройти полноценное ревью.

Рекомендуем посмотреть курсы по backend разработке

| Курс | Школа | Цена | Рассрочка | Длительность | Дата начала | Ссылка на курс |

|---|---|---|---|---|---|---|

|

IT-специалист с нуля

|

Eduson Academy

114 отзывов

|

Цена

122 500 ₽

|

От

10 208 ₽/мес

0% на 24 месяца

11 239 ₽/мес

|

Длительность

12 месяцев

|

Старт

24 марта

|

Подробнее |

|

Бэкенд-разработчик

|

HTML Academy

34 отзыва

|

Цена

30 600 ₽

46 000 ₽

|

От

1 700 ₽/мес

На 18 месяцев

2 453 ₽/мес

|

Длительность

11 месяцев

|

Старт

в любое время

|

Подробнее |

|

Веб-разработчик с нуля

|

Нетология

46 отзывов

|

Цена

163 300 ₽

302 470 ₽

с промокодом kursy-online

|

От

5 041 ₽/мес

Без переплат на 2 года.

7 222 ₽/мес

|

Длительность

17 месяцев

|

Старт

5 апреля

|

Подробнее |

|

FastAPI — погружение в backend разработку на Python

|

Stepik

33 отзыва

|

Цена

250 000 ₽

|

|

Длительность

4 месяца

|

Старт

в любое время

|

Подробнее |

|

Профессия Fullstack-разработчик на Python

|

Skillbox

232 отзыва

|

Цена

146 073 ₽

292 147 ₽

Ещё -20% по промокоду

|

От

4 296 ₽/мес

|

Длительность

12 месяцев

|

Старт

19 марта

|

Подробнее |

Каждый третий россиянин уверен: он справился бы с работой своего начальника лучше

Исследование Работа.ру выявило интригующий разрыв: треть россиян уверена в своих управленческих способностях, но большинство не готово брать на себя реальную ответственность. Рассказываем, что за этим стоит и что делать тем, кто действительно хочет вырасти до руководителя.

Яндекс Практикум vs Contented: Figma/UI — где быстрее собрать 3 кейса и получить внятные правки

Выбираете между курсами UX/UI дизайна в Яндекс Практикуме и Contented? Разбираем, где быстрее собрать три сильных кейса в портфолио, как устроены ревью проектов и на что обратить внимание при выборе обучения.

Яндекс Практикум vs Bang Bang Education: сравниваем методологию и упаковку кейсов для UX-исследователей

UX-исследования — с чего начать и какой курс выбрать? Разбираем методологию, формат обучения и портфолио, чтобы вы не ошиблись с выбором.

Яндекс Практикум vs Stepik: SQL с нуля — что быстрее даёт навык «решать задачи», а не «знать команды»

Stepik или Яндекс Практикум — где быстрее освоить SQL-аналитику и научиться решать реальные задачи? Разбираем формат обучения, типы практики и ключевые различия платформ, которые влияют на скорость роста навыка.